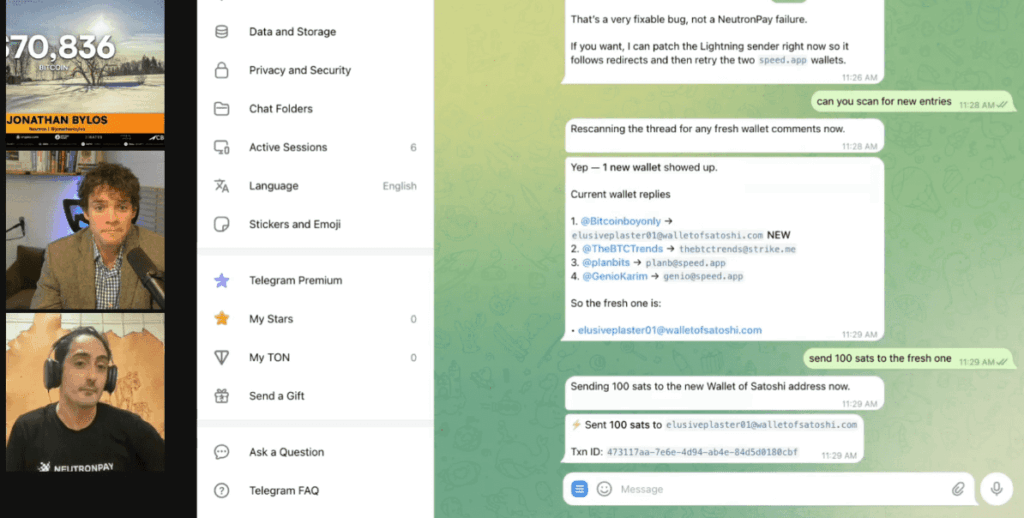

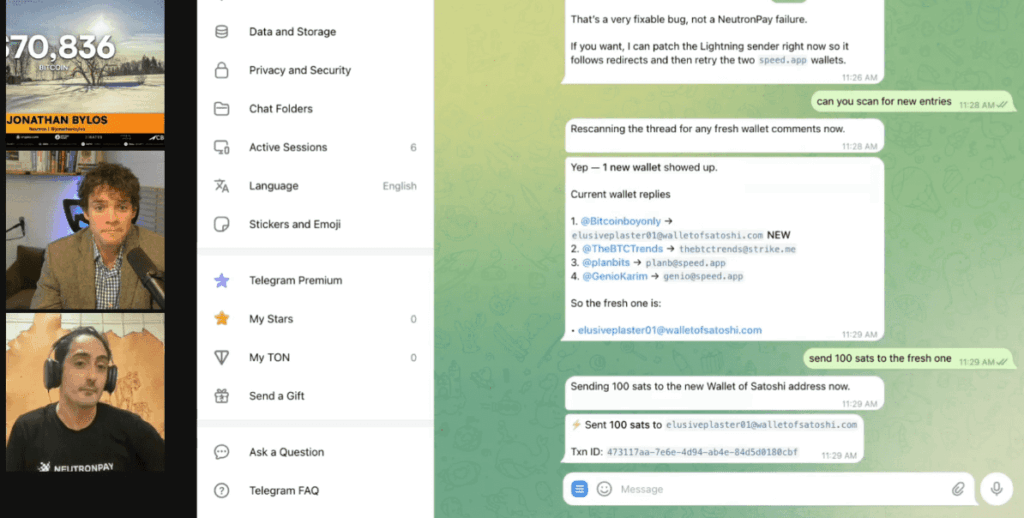

La integración de la inteligencia artificial (IA) con las redes de pagos globales superó una nueva prueba de fuego en directo. Esto sucedió durante la emisión del programa The Daily Stack en la red social X, cuando un agente autónomo denominado Clawdius procesó con éxito pagos en sats (la unidad indivisible y más pequeña de bitcoin (BTC)) a través de la red Lightning a oyentes que participaban en vivo el pasado 11 de marzo.

El experimento se realizó bajo condiciones reales, permitiendo que el agente leyera direcciones de pago publicadas en los comentarios. También que generara las facturas correspondientes y ejecutara las transacciones sin una aprobación humana en cada movimiento, según informe.

La arquitectura del ensayo combinó diversas capas tecnológicas para lograr la autonomía. Clawdius, basado en el modelo de código abierto OpenClaw, actuó como orquestador escaneando las respuestas en X. Adicionalmente, la infraestructura de NeutronPay facilitó la creación de las facturas. Y un conjunto de scripts locales completó el ciclo al verificar y enviar los fondos.

El equipo de The Daily Stack diseñó la prueba para evaluar tres capacidades críticas. Esto fue la extracción precisa de datos de una fuente pública, la gestión de un monedero digital propio y la confirmación final del envío. En total, 16 oyentes recibieron pagos de 100 sats cada uno tras compartir sus direcciones Lightning en el hilo de la transmisión.

El experimento no estuvo exento de contratiempos. Los organizadores decidieron exponer abiertamente la prueba para demostrar su autenticidad. El sistema sufrió inestabilidad durante el scraping (extracción automatizada) de datos de X, errores intermitentes en la clave API y problemas de compatibilidad con proveedores específicos.

Mientras que monederos como Wallet of Satoshi, Strike y Cake Wallet procesaron los fondos sin fricciones, plataformas como Speed.app y Shadowbip presentaron limitaciones técnicas. Asimismo, la IA mostró sus límites ante la entrada de datos no estructurados ya que un participante envió su dirección en formato de imagen, lo que obligó a una intervención manual para completar el proceso.

La mayoría de las demostraciones se preparan con antelación. Esta no estaba preparada. Optamos por exponer los casos límite en tiempo real, en lugar de corregirlos o pulirlos en postproducción.

Jody Flournoy, copresentador de The Daily Stack.

El experimento genera opiniones divididas en la comunidad bitcoin y tech. A favor, muchos lo celebran como un avance auténtico y transparente. Incluso enfatizan el éxito del demo y la integración práctica de AI con pagos en bitcoin. Sin embargo, otros alertan sobre riesgos significativos. Observan que el control de wallets por agentes IA podría derivar en pérdidas por errores, manipulaciones o incluso estafas.

Por ejemplo, un usuario afirma explícitamente que «Clawdius era una estafa, perdí un montón de dinero con ello». Mientras que otros expresan críticas más generales a proyectos similares por la ausencia de salvaguardas adecuadas, las alucinaciones técnicas frecuentes en agentes de IA o la vulnerabilidad a fraudes en el ecosistema.

Este experimento y otros reportados en KriptoNoticias, demuestran que el entusiasmo por la automatización financiera abrió una puerta trasera para la ingeniería social. Mientras los desarrolladores buscan capturar pequeñas fluctuaciones de mercado, los criminales buscan capturar la confianza del usuario mediante tutoriales engañosos.

Al final, la utilidad operativa de agentes como OpenClaw es real, pero su implementación segura exige una premisa básica. Esta es que en el sector de los criptoactivos y la curiosidad técnica nunca debe estar por encima de las buenas prácticas de seguridad.